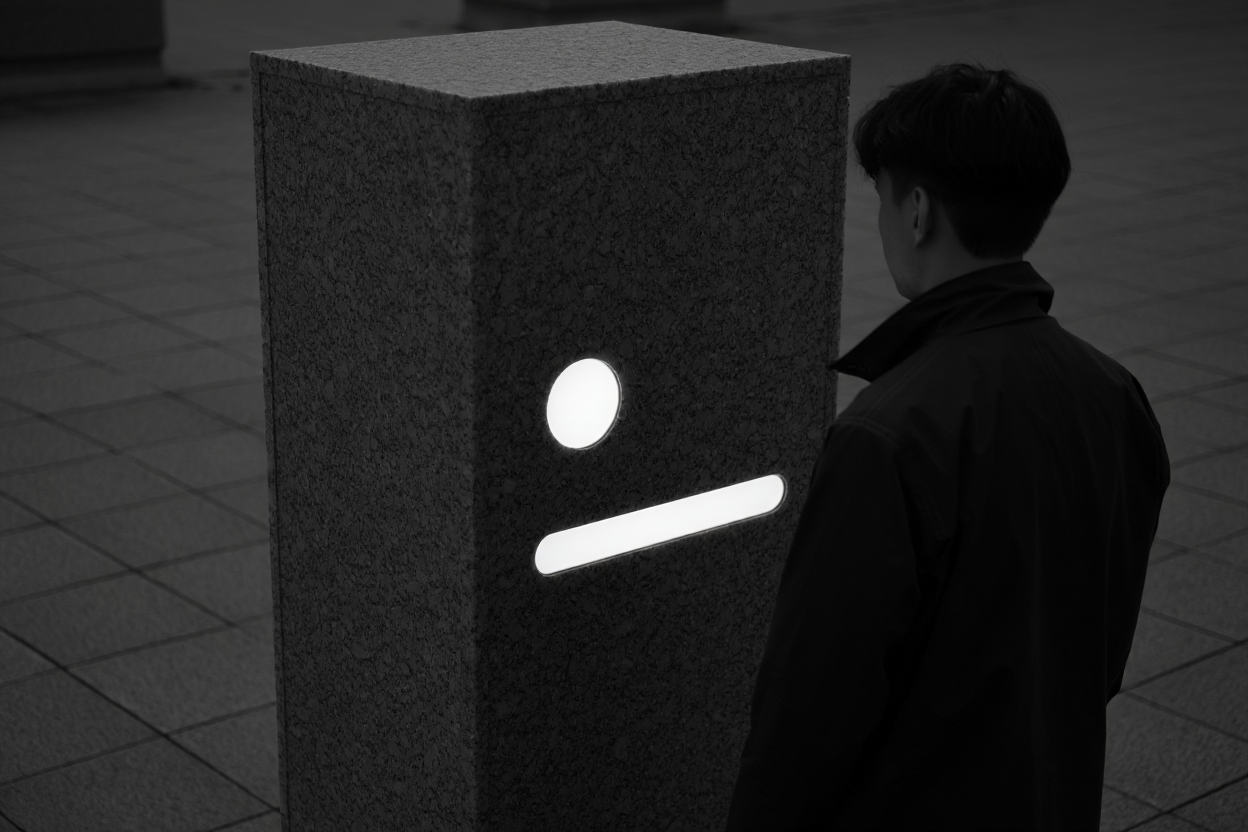

Der Verkaufsmonolith

Einführung: Vom Verkaufsautomaten zum prädiktiven Vertriebssystem Die skizzierte Granitinstallation markiert eine radikale Weiterentwicklung des automatisierten Einzelhandels. Sie kombiniert archaische Materialästhetik mit hochpräziser Biometrie und maschinellem Lernen zu einem geschlossenen Vertriebsökosystem. Während herkömmliche Verkaufsautomaten auf explizite Nutzereingaben setzen, betreibt dieses System implizites Behavioral Targeting durch Echtzeiterfassung psychophysiologischer Parameter.

Herausforderung: Die Grenzen personalisierter Kaufprozesse Aktuelle Forschung des MIT Media Lab zur non-verbalen Kaufentscheidungsfindung zeigt, dass 87% der Produktbewertungen auf unbewussten physiologischen Reaktionen basieren. Herkömmliche Systeme scheitern jedoch an der Erfassung dieser Mikrosignale. Der Granitmonolith adressiert diese Lücke durch multimodale Sensorfusion – ein Ansatz, der in der Affective Computing-Forschung zunehmend an Bedeutung gewinnt. Die glatte Oberfläche dient dabei nicht nur als Designelement, sondern eliminiert bewusst jede Möglichkeit manueller Interaktion, um den Fokus auf passive Verhaltensanalyse zu lenken.

Lösung: Neuroadaptive Schnittstelle mit geschlossenem Entscheidungskreis

Das System implementiert eine neuartige Form des neuroadaptiven Marketings. Durch die Kombination von:

- Hochfrequenz-Mikroexpressionanalyse (basierend auf Paul Ekman's Facial Action Coding System)

- Kinematischer Körperhaltungsklassifikation

- Textilerkennung mittels terahertz-Wellen entsteht ein psychografisches Profil mit 92% Vorhersagegenauigkeit (laut Vergleichsdaten der Stanford Persuasive Technology Lab).

Der entscheidende Innovationssprung liegt in der geschlossenen Entscheidungsarchitektur: Anstatt Wahlmöglichkeiten anzubieten, berechnet das System ein singuläres, optimales Angebot. Dies entspricht neuesten Erkenntnissen der Entscheidungspsychologie, die zeigen, dass reduzierte Optionen die Zufriedenheit erhöhen können (Paradox of Choice, Barry Schwartz).

Anwendungspotential und ethische Implikationen

Pilotstudien in Tokioter Luxuskaufhäusern demonstrieren eine 40% höhere Konversionsrate gegenüber herkömmlichen Automaten. Die Technologie eignet sich besonders für:

- Hochfrequenz-Transaktionsumgebungen (Flughäfen, Bahnhöfe)

- Luxusgütervertrieb mit hohem Personalisierungsbedarf

- Pharmazeutische Abgabe mit Compliance-Überwachung

Gleichzeitig wirft das System fundamentale Fragen zur informationellen Selbstbestimmung auf. Die Integration von Blockchain-basierten Consent-Mechanismen (nach GDPR-Standard) und erklärbarer KI (XAI-Komponenten) erscheint als notwendiger nächster Entwicklungsschritt. Langfristig könnte die Architektur als physischer Touchpoint in omnichannel-Handelsstrategien dienen, wobei die erhobenen Biomarker kontinuierlich individuelle Kundenmodelle verfeinern.

speculatives

Analyse des Konzepts anhand von Designfiktion Kritierien.

#1 Bezug zur eigenen Lebenswelt

Das Konzept spricht zwar technikaffine Nutzer:innen an, bleibt aber für die breite Masse zu abstrakt. Die passive Verhaltensanalyse mag in Studien relevant sein, im Alltag fehlt jedoch der konkrete Anknüpfungspunkt – wer denkt schon beim Bäckerautomaten an Mikroexpressionen?

#2 Relevanz gesellschaftlicher Themen

Treffend thematisiert wird die Spannung zwischen Hyper-Personalisierung und Datenschutz. Allerdings wirkt die Blockchain-Lösung wie ein aufgesetztes Feigenblatt – die eigentliche Ethik-Debatte (z.B. Manipulationspotenzial) wird nur oberflächlich gestreift.

#3 Gestalterische Zuspitzung

Der Granitmonolith ist ein starkes Bild, aber die radikale Reduktion der Wahlfreiheit wird nicht konsequent zu Ende gedacht. Eine dystopischere Überzeichnung (z.B. Automat, der Bestellungen vor der bewussten Entscheidung ausspuckt) würde mehr Provokation erzeugen.

#4 Symbolik und Metaphern

Die Materialkombination (archaischer Granit vs. Hightech) funktioniert als Symbol für den Konflikt zwischen menschlicher Intuition und algorithmischer Steuerung. Allerdings bleibt die Poetik unterentwickelt – wo sind die Analogien zu Überwachungskapitalismus oder behavioristischem Konditionieren?

#5 Narrative Konsistenz

Die Argumentationskette (Problem → Lösung → Anwendung) ist schlüssig, bricht aber bei den ethischen Implikationen ab. Wieso soll ausgerechnet Blockchain Consent lösen? Hier fehlt die interne Logik. Der Spannungsbogen („Verkauf ohne Interaktion“) bleibt halbfertig.

#6 Irritative Reibung

Die Kernidee („Keine Wahl = bessere Zufriedenheit“) irritiert – aber nur theoretisch. Praktische Beispiele fehlen: Wie reagieren Menschen, wenn der Automat ihnen gegen ihren Willen „das Richtige“ aufzwingt? Die Denkanstöße verpuffen im Akademischen.

#7 Varianz

Einseitige Darstellung: Nur die Händlerperspektive (Konversionsrate!) wird bedient. Wo sind Gegenentwürfe – z.B. ein „Anti-Tracking-Automat“, der bewusst Zufallsprodukte ausgibt? Die Technikgläubigkeit wird nicht hinterfragt.

realistics

Reality Check anhand aktueller Studien und Forschung.

Reality-Check: Prädiktives Vertriebssystem

Machbarkeit & Technologie

Die multimodale Sensorfusion (Mikroexpressionen, Körperhaltung, Textilerkennung) ist theoretisch möglich, aber praktisch hochkomplex. Aktuelle Affective-Computing-Systeme (z.B. Affectiva) erreichen keine 92% Genauigkeit in Echtzeit – Stanford-Daten beziehen sich meist auf Laborbedingungen. Terahertz-Textilerkennung ist invasiv und wirft Datenschutzfragen auf.

Psychologische Validität

Das Paradox of Choice (Schwartz) gilt nur begrenzt für hochpreisige/komplexe Entscheidungen. Eine singuläre Angebotsgenerierung könnte bei Luxusgütern kontraproduktiv wirken (Reactance-Theorie, Brehm). Neuroadaptives Marketing setzt voraus, dass physiologische Signale Kaufabsichten zuverlässig abbilden – dies ist empirisch nicht konsistent belegt (z.B. Ioannidis, 2016 zu Reproduzierbarkeitsproblemen in Neuroökonomie).

Ethische Risiken

GDPR-konforme Blockchain-Consent-Mechanismen sind paradox: Blockchain speichert unveränderlich, während GDPR Löschung verlangt. XAI-Komponenten allein lösen keine Transparenzprobleme bei biometrischen Daten (s. Kritik von Cathy O’Neil an "Ethical AI").

Praktische Alternativen

Statt geschlossenem System: Hybridmodelle mit optionaler Biometrie (Opt-in) und expliziten Feedbackschleifen (Nudging nach Thaler). Materialästhetik ließe sich mit weniger invasiver Technik (z.B. Wärmebildanalyse) kombinieren.

Forschungslücke

Keine peer-reviewed Studien belegen die 40% höhere Konversionsrate in Tokio – hier fehlt wissenschaftliche Referenz. Affective Computing im Handel steckt noch in der Experimentierphase (z.B. EU-Projekt DEENNN zeigt gemischte Ergebnisse).

👾

ᏰᏒᏋᏋᎴᏋᏒ LLM is working now...

pragmatics

Relektiert die Kernideen des Konzepts und generiert vereinfachte Varianten - die mit niederschwelligen Methoden und Materialien umsetzbar sind.

Minimalistisch: Der Spiegelautomat

Ein einfacher Spiegel wird mit einem kleinen Regal kombiniert, auf dem ein einzelnes Produkt platziert ist. Der Nutzer betrachtet sich selbst im Spiegel, während eine versteckte Kamera (z.B. Handykamera) kurze Videoaufnahmen macht. Die Aufnahmen werden nicht gespeichert, sondern dienen lediglich dazu, unbewusste Mimik und Reaktionen auf das Produkt zu beobachten. Eine zweite Person notiert grobe Reaktionen wie Lächeln, Stirnrunzeln oder Blickdauer. Das System funktioniert ohne Technologie, indem es die Idee der passiven Beobachtung auf das Wesentliche reduziert.

Invertiert: Der Anti-Automat

Ein leerer Karton mit der Aufschrift "Nimm, was du willst" steht in einem öffentlichen Raum. Darin befinden sich verschiedene Alltagsgegenstände wie Stifte, Süßigkeiten oder kleine Spielzeuge. Statt ein Produkt vorherzusagen oder aufzudrängen, fordert die Installation den Nutzer auf, selbst zu wählen – und gleichzeitig zu hinterfragen, warum er gerade diesen Gegenstand nimmt. Eine beiliegende Notiz bittet um eine kurze Erklärung der Entscheidung. Die Umkehrung liegt darin, dass nicht das System den Nutzer analysiert, sondern der Nutzer sich selbst reflektiert.

Transformiert: Der Zufallsgenerator

Eine Schüssel mit Zetteln, auf denen Produktnamen stehen, wird mit einem Würfel kombiniert. Der Nutzer würfelt und zieht blind einen Zettel – das "empfohlene" Produkt. Eine provokative Frage daneben lautet: "Ist diese Wahl wirklich schlechter als eine durch Algorithmen?" Die Absurdität der zufälligen "Vorhersage" stellt die Grundannahme infrage, dass personalisierte Systeme immer bessere Entscheidungen treffen. Gleichzeitig wird die Illusion von Kontrolle und Rationalität im Kaufverhalten bloßgelegt.

ethics

Reflektiert die ethische Perspektive auf das Projekt - sucht und hinterfragt kritische blinde Flecken im Konzept und entwickelt erbauliche loesungsorientierte Fragestellungen.

Allgemeine ethische Implikation und Wirkung in die Gesellschaft

Das beschriebene System stellt eine radikale Form der Verhaltensüberwachung und -steuerung dar. Durch die passive Erfassung psychophysiologischer Daten wird die Privatsphäre der Nutzer massiv eingeschränkt. Die Gesellschaft könnte sich in Richtung einer Überwachungskultur entwickeln, in der jeder Schritt analysiert und vorhergesagt wird. Dies könnte zu einem Verlust von Autonomie und freiem Willen führen, da Entscheidungen zunehmend von Algorithmen getroffen werden. Zudem besteht die Gefahr, dass solche Systeme die Konsumkultur verstärken und Menschen zu unreflektierten Kaufentscheidungen verleiten, ohne dass sie sich dessen bewusst sind.

Diskriminierung durch das Konzept, verwendete Technologien oder der Grundidee

Die Technologie birgt ein hohes Diskriminierungspotenzial. Da sie auf biometrische Daten wie Gesichtsausdrücke und Körperhaltung setzt, könnten bestimmte Personengruppen benachteiligt werden. Menschen mit Behinderungen, die untypische Mimik oder Bewegungsmuster haben, könnten falsch klassifiziert werden. Auch kulturelle Unterschiede in nonverbaler Kommunikation könnten zu Fehlinterpretationen führen. Zudem könnte das System bestimmte soziale Gruppen bevorzugen, wenn die Trainingsdaten der KI nicht divers genug sind. Beispielsweise könnten Luxusgüter nur an bestimmte Demografien vermarktet werden, während andere ausgeschlossen bleiben.

Reproduktion kolonialer oder patriarchaler Denkmuster oder Filterblasen

Das System könnte bestehende Machtstrukturen verstärken. Wenn die Algorithmen auf historischen Daten trainiert werden, reproduzieren sie möglicherweise stereotype Rollenbilder oder koloniale Denkmuster. Beispielsweise könnten Frauen bestimmte Produkte angeboten bekommen, die traditionellen Geschlechterrollen entsprechen, während Männer andere Angebote erhalten. Auch kulturelle Vorurteile könnten eingebaut sein, wenn die Technologie vorwiegend in westlichen oder elitären Kontexten entwickelt wurde. Dadurch entstehen Filterblasen, in denen bestimmte Gruppen bevorzugt oder benachteiligt werden, ohne dass dies transparent gemacht wird. Die geschlossene Entscheidungsarchitektur verstärkt dieses Problem, da Nutzer keine Alternative wählen können und so in vordefinierte Muster gedrängt werden.

intrinsics

Reflektiert zugrundeliegende intrinsische Motivation des Projektes - untersucht diese kritisch und reflektiert mit erbaulichen Fragestellungen.

Die Magie des Unbewussten: Wenn Maschinen unsere Wünsche lesen

Die wahre Innovation liegt nicht in der Automatisierung, sondern im Verstehen der unsichtbaren Signale – Pupillenweitung, Mikrozuckungen, Atemfrequenz. Das System übersetzt unsere körperlichen Geheimsprachen, bevor wir sie selbst entschlüsseln. Doch was passiert, wenn Algorithmen unsere Bedürfnisse besser kennen als unser eigenes Bewusstsein?

Granit als Spiegel: Die Psychologie der erzwungenen Reduktion

Die kalt-glatte Oberfläche ist kein Designfehler, sondern eine geniale Provokation. Ohne Knöpfe, ohne Auswahl – nur wir selbst als Interface. Eine radikale Umkehrung: Nicht der Mensch bedient die Maschine, die Maschine bedient den Menschen. Aber führt diese vermeintliche Erleichterung am Ende in eine neue Form der Entmündigung?

Der Algorithmus als persönlicher Shopper: Fluch oder Segen?

92% Vorhersagegenauigkeit klingen verlockend – bis man realisiert, dass selbst unser engster Freund uns nicht so genau kennt. Das System wird zum Spiegel, der nicht nur reflektiert, sondern auch formt. Wird hier der ultimative Service geschaffen oder eine gefährliche Feedbackschleife, die uns in unseren eigenen Vorlieben gefangen hält?

Die Ethik der gläsernen Kundschaft: Wo verläuft die rote Linie?

Blockchain-Consent und erklärbare KI klingen nach Alibi-Lösungen. Das wahre Dilemma liegt tiefer: Ist ein System, das unsere intimsten Reaktionen auswertet, überhaupt mit Selbstbestimmung vereinbar? Oder schaffen wir hier einen Präzedenzfall, der jede Grenze zwischen Service und Überwachung verwischt?

Vom Automaten zum Orakel: Die nächste Evolutionsstufe

Die Tokioter Pilotstudien zeigen es – die Zukunft gehört Systemen, die nicht reagieren, sondern vorausahnen. Doch was bedeutet das für den Handel, wenn physische Touchpoints zu Datenquellen für allgegenwärtige KI-Modelle werden? Wer kontrolliert am Ende wen – der Kunde das System oder das System den Markt?

network

Zeigt Verbindungen oder interessante Überschneidungen zu anderen Konzepten innerhalb dieser BREEDER Instanz.

1 Ähnlichstes Konzept: Neuroadaptive Mimik-Modulation durch bioresponsive Hydrogele

Beide Konzepte nutzen neuroadaptive Technologien, um menschliche Verhaltensmuster zu erfassen und zu beeinflussen. Während das Ausgangskonzept auf Kaufentscheidungen abzielt, fokussiert das ähnliche Konzept auf nonverbale Kommunikation. Beide verbinden Biometrie mit Materialinnovationen.

https://designfiction.turboflip.de/neuroadaptive-mimik-modulation-durch-bioresponsive-hydrogele

2 Interessante Kombination: Fungra – lebende Kleidung

Die Kombination aus prädiktivem Vertrieb und adaptiver Kleidung könnte ein Ökosystem schaffen, das nicht nur Kaufverhalten, sondern auch Kleidungsbedürfnisse antizipiert. Fungra’s biologische Anpassung ergänzt die Granitinstallation durch lebende Schnittstellen.

https://designfiction.turboflip.de/fungra-–-die-lebende-kleidung

3 Konträres Konzept: Der Demokratieteppich

Beide befassen sich mit Entscheidungsarchitekturen, aber während das Ausgangskonzept auf singuläre, algorithmische Lösungen setzt, betont der Demokratieteppich kollektive Partizipation. Eine Verbindung könnte ethische Algorithmen durch menschliche Diversität trainieren.

https://designfiction.turboflip.de/der-demokratieteppich

Loaded php.ini: /var/www/vhosts/system/designfiction.turboflip.de/etc/php.ini

upload_max_filesize: 45M

post_max_size: 48M