DreamScore Cities

Konzept

In einer nahen Zukunft leben Menschen in Städten mit einem kollektiven „DreamScore“. Das Erscheinungsbild der Städte hängt vom Verhalten aller Bewohner ab. Je besser sich die Community verhält, desto schöner wird die Umgebung. Jeder trägt ein Band, das das soziale Verhalten der Personen misst und basierend darauf Punkte vergibt. Wenn man sich nicht angemessen verhält, werden Punkte abgezogen. Jede Person sieht die Stadt in einem individuellem Mixed-Reality-Overlay durch eine implantierte Kontaktlinse. Diese Wahrnehmung ist nicht optional, sondern Standard der Gesellschaft. Das, was die Personen sehen, basiert auf:

- dem Score der Stadt

- dem eigenen Verhalten

- sowie dem eigenen „Wahrnehmungstypus“ (z. B. Farbsensitivität, Kindheitserinnerungen, Ästhetikprofil)

Das System wurde ursprünglich von politischen Entscheidungsträgern nach sozialen Krisen eingeführt. Inzwischen wird es vollständig von einer übergeordneten KI verwaltet, die nicht nur das Punktesystem überwacht, sondern auch die Regeln kontinuierlich anpasst. Die Politik existiert nur noch als symbolische Instanz, Entscheidungen trifft der Algorithmus. Offiziell heißt es: „Für das Wohl der Gemeinschaft.“

Armband, das das Verhalten misst

Armband, das das Verhalten misst

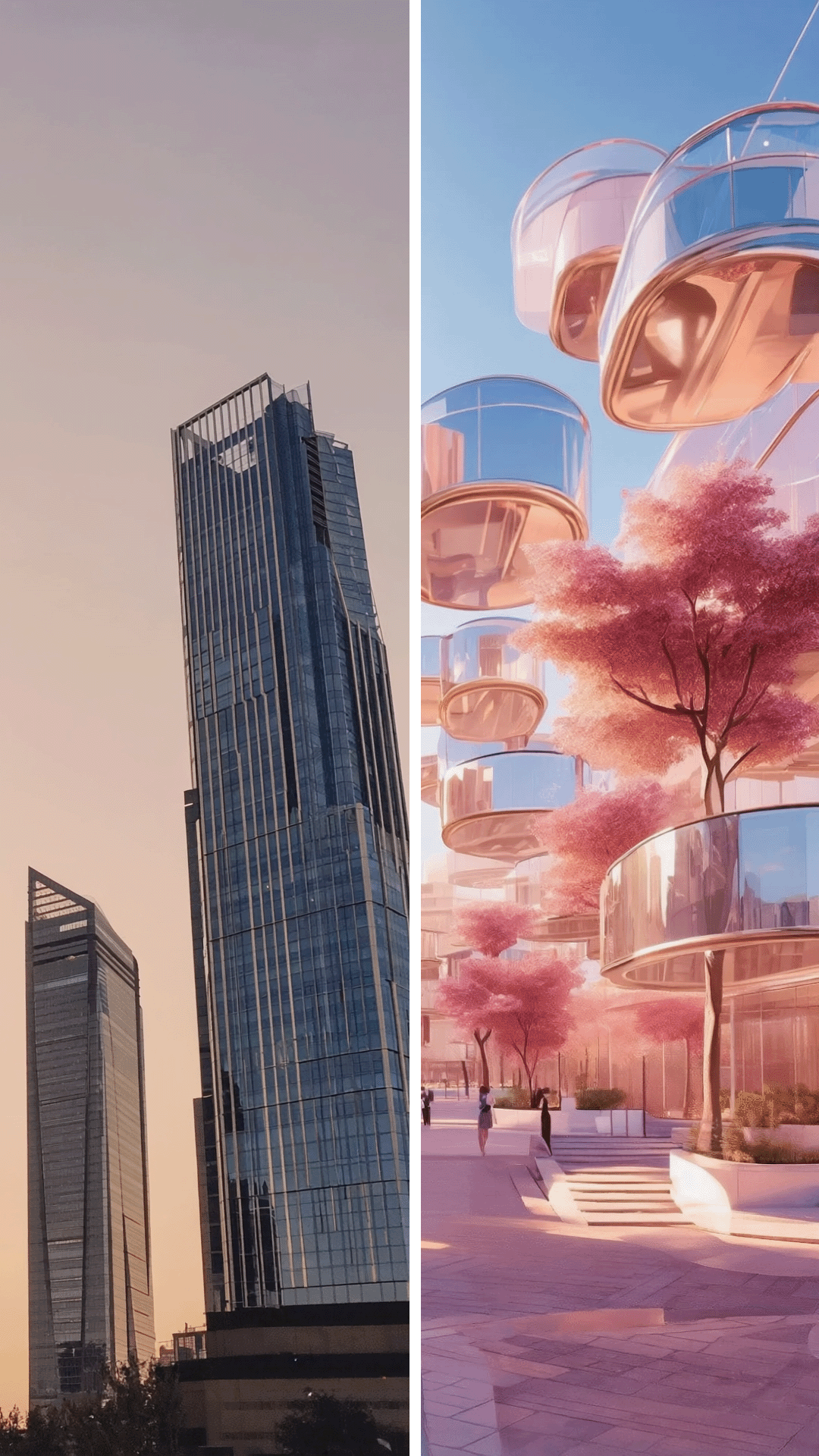

Erscheinungsbild der Städte

Da jede Person eine individuelle Wahrnehmung davon hat, was sich angenehm, schön, gruselig oder unwohl anfühlt, sehen die Menschen nicht alle das gleiche Stadtbild. Jede Person sieht eine eigene Version der Stadt, die durch eine implantierte Kontaktlinse erzeugt wird. Für eine Person kann eine angenehme Stadt eine Barbie-Ästhetik haben, für jemand anderen ist es eine klare, minimalistische Umgebung.

Punktesystem

Ein intelligentes Überwachungssystem analysiert:

- nonverbales Verhalten (Körpersprache, Mimik, Nähe),

- soziale Interaktionen (Zuhören, Streit, Ignoranz),

- emotionale Reaktionen (via Gesichtsausdrucks-Analyse),

- körperliche Parameter (Puls, Bewegung, gesunder Lebensstil via Armband).

Ein KI-gestütztes System analysiert, ob das Verhalten als „harmonisch“, „förderlich“ oder „störend“ einzuordnen gilt. Punkte werden den Personen automatisch hinzugefügt oder abgezogen. Öffentliche und private Räume sind mit Kameras und Sensoren ausgestattet. Es werden Verhaltensdaten gesammelt und ausgewertet.

Beispiele:

- Jemandem helfen, zuhören: +10 Punkte

- Unhöflichkeit, Konflikte: –15 Punkte

- Soziale Isolation, Rückzug: –10 Punkte

Zwei Scores bestimmen die Wahrnehmung:

- Individueller Score: sichtbar für alle – als Zahl über der Person, zu sehen über die Kontaktlinse.

- Stadt-Score: ergibt sich aus dem Mittelwert aller Bewohner im Gebiet.

Der Score könnte folgendermaßen aussehen, die Umgebung sieht aber für jede Person anders aus, je nach Wahrnehmungstyp:

- 90–100 Punkte → Traumhaft: Rosa Himmel, sanfte Musik, blühende Pflanzen

- 70–89 Punkte → Stabil: Etwas blasser, monotone Musik, etwas steif, aber sicher

- 50–69 Punkte → Brüchig: Risse in Gebäuden, Licht flackert, bedrückende Stimmung

- 0–49 Punkte → Albtraum: Stille, Nebel, schwarze Risse, Druck zur Anpassung

Für zwei Personen kann die selbe Stadt so aussehen

Für zwei Personen kann die selbe Stadt so aussehen

Regelwerk (Auszug)

-

Soziale Interaktion ist wertvoll: Positive Kontakte (zuhören, helfen, teilhaben) steigern den Score. Isolation oder Konflikte senken ihn.

-

Visuelle Umgebung als Spiegel: Das Stadtbild passt sich täglich dem Score an – subtil oder drastisch, je nach Entwicklung.

-

Kollektiver Score übertrifft individuellen Score: Wenn die Stadt im Schnitt über 80 liegt, erhalten alle Bonuspunkte – auch schwächere Individuen.

-

Balance durch Community: Wer Fehlverhalten beobachtet, kann durch eigenes positives Verhalten ausgleichen – oder es melden.

-

Schutz vor Score-Verfall: Sinkt der Score unter 50, werden gezielte Maßnahmen aktiviert: z. B. DreamExile-Zonen, erzwungene Social-Tasks oder Re-Integrationseinheiten.

Gesellschaftliche Folgen

Das System führt zu gesellschaftlichen Veränderungen. Da der DreamScore nicht nur individuell, sondern für die ganze Stadt zählt, entsteht ein Gruppenzwang. Die Verantwortung gegenüber der Gemeinschaft steht im Fokus. Wer sich nicht „angemessen“ verhält, riskiert, den Score der Stadt zu senken. Dies fördert Mitläufertum, soziale Kontrolle und Misstrauen. Menschen beginnen, einander zu beobachten, zu bewerten und sogar zu korrigieren, um die Illusion der perfekten Welt aufrechtzuerhalten. Es reicht nicht mehr, sich selbst gut zu verhalten. Man muss auch dafür sorgen, dass andere es tun. Negative Verhaltensweisen können zwar durch positives Verhalten anderer ausgeglichen werden, aber es dürfen nicht zu viele Personen einen schlechten Score haben.

Auswirkungen

Menschen mit besonders schlechtem Individualwert können in separate Zonen ausgelagert werden, um den städtischen Durchschnitt zu verbessern. Gleichzeitig entstehen durch das Bewertungssystem neue soziale Schichten. Ganze Stadtteile können zu Ghettos werden, wenn Unzufriedenheit und Regelverweigerung überwiegen. Auf der anderen Seite konkurrieren Städte im DreamScore miteinander, was zu einem gamifizierten Wettbewerb zwischen Orten führt.

speculatives

Analyse des Konzepts anhand von Designfiktion Kritierien.

#1 Bezug zur eigenen Lebenswelt

Das Konzept greift reale Ängste und Mechanismen auf: Sozialkreditsysteme (China), Gamification von Verhalten (wie in Apps) und kollektive Verantwortung (z. B. Nachbarschafts-Apps). Die persönliche Verbindung entsteht durch die Frage: Wie würde ich mich unter ständiger Bewertung fühlen?

Lösungsidee: Ein partizipatives Element einbauen – z. B. temporäre „Opt-out“-Phasen, in denen Menschen die Kontaktlinsen entfernen dürfen, um reale und virtuelle Welt zu vergleichen.

#2 Relevanz gesellschaftlicher Themen

Aktuell hochrelevant: Digitale Überwachung, KI-gesteuerte Sozialkontrolle, Gamification von Moral. Das Konzept spitzt diese Trends zu, bleibt aber nah an realen Entwicklungen (z. B. Scoring-Systeme in Unternehmen).

Lösungsidee: Explizite Bezüge zu heutigen Debatten herstellen – z. B. wie „Harmonie“-Erwartungen in sozialen Medien bereits jetzt Verhalten steuern.

#3 Gestalterische Zuspitzung

Die Überspitzung gelingt gut (z. B. „Barbie-Ästhetik“ vs. „Albtraum“), aber die KI als undurchschaubare Macht wirkt etwas klischeehaft.

Lösungsidee: Die KI könnte fehlbar sein – z. B. durch Bugs, die plötzlich alle Gebäude in Klötzchenoptik rendern, um die Fragilität des Systems zu zeigen.

#4 Symbolik und Metaphern

Starke Metaphern („Risse in Gebäuden“ = soziale Brüche), aber die individuelle Wahrnehmung bleibt vage. Wie genau Kindheitserinnerungen die Ästhetik prägen, wird nicht klar.

Lösungsidee: Konkrete Beispiele – z. B. jemand, der als Kind im Wald spielte, sieht Bäume statt Laternen.

#5 Narrative Konsistenz

Schlüssig, aber die KI als deus ex machina wirkt zu omnipotent. Warum akzeptieren Menschen das System trotz offensichtlicher Nachteile (z. B. Exil-Zonen)?

Lösungsidee: Historische Eskalation zeigen – z. B. wie anfangs nur „Belohnungen“ lockten, dann Sanktionen schleichend eingeführt wurden.

#6 Irritative Reibung

Gut: Der Zwang zur Harmonie entlarvt sich selbst („Mitläufertum“). Aber die Alternativlosigkeit des Systems könnte stärker hinterfragt werden.

Lösungsidee: Untergrundbewegungen einführen, die die Linsen hacken oder „schlechte“ Scores als Protest tragen.

#7 Varianz

Die Grundidee wird ausdifferenziert (individuelle Scores, Stadt-Scores), aber die „Wahrnehmungstypen“ bleiben unterentwickelt.

Lösungsidee: Extreme Gegensätze zeigen – z. B. einen Künstler, der den Albtraum-Status ästhetisch findet, oder Eltern, die ihre Kinder zum „Score-Hacking

realistics

Reality Check anhand aktueller Studien und Forschung.

Behavioristische Utopie vs. Dystopie

Das Konzept operationalisiert Verhalten durch ein Punktesystem – eine behavioristische Idee (Skinner, Walden Two). Doch die Externalisierung von Moral durch KI birgt Risiken: Wer definiert „harmonisch“? Aktuelle Forschung zeigt, dass Algorithmen soziale Vorurteile verstärken (z. B. Buolamwini/Gebru, Gender Shades). Die KI-gesteuerte Anpassung der Regeln könnte willkürlich werden, da sie keine demokratische Legitimation hat.

Pragmatische Alternative:

Statt Zwang: Ein freiwilliges „Gamification“-System mit transparenten Kriterien, das Belohnungen (z. B. Steuerermäßigungen) statt Bestrafungen nutzt.

Technische Machbarkeit

Die smarte Kontaktlinse ist theoretisch möglich (Mojo Vision arbeitet an AR-Linsen), aber Echtzeit-Mixed-Reality-Rendering für individuelle Stadtwahrnehmungen überfordert heutige Hardware. Die Verhaltensanalyse via Wearables ist fragwürdig: Emotionen lassen sich nicht zuverlässig aus Puls oder Mimik ableiten (Lisa Feldman Barrett, How Emotions Are Made).

Lösungsansatz:

Beschränkung auf nachweisbare Metriken (z. B. Teilnahme an Gemeinschaftsaktionen) statt pseudowissenschaftlicher Emotional Analytics.

Soziale Dynamiken

Das System fördert Konformität – ähnlich Chinas „Social Credit“, aber mit ästhetischer Bestrafung. Studien zeigen, dass öffentliche Bewertungssysteme zu sozialer Angst führen (z. B. Rosenblat et al., Uberland). Der „DreamExile“-Mechanismus schafft de facto digitale Kasten.

Gegenmodell:

Stadtviertel könnten kollektiv über ästhetische Gestaltung abstimmen (Partizipationsmodell) – ohne individuelle Stigmatisierung.

Ethische Implikationen

Die erzwungene Wahrnehmungsmanipulation widerspricht neurodiversen Bedürfnissen (z. B. Autisten könnten mit willkürlichen visuellen Changes überfordert sein). Die Idee, dass „schlechte“ Bürger die Stadt „hässlich“ machen, pathologisiert soziale Konflikte.

Kreative Wendung:

Nutzer*innen könnten ihr Overlay selbst kuratieren – z. B. als künstlerisches Tool zur Stadterkundung, nicht als Disziplinarmaßnahme.

👾

ᏰᏒᏋᏋᎴᏋᏒ LLM is working now...

pragmatics

Relektiert die Kernideen des Konzepts und generiert vereinfachte Varianten - die mit niederschwelligen Methoden und Materialien umsetzbar sind.

Minimalistisch – Verhaltens-Score-Armband aus Papier

Ein einfaches Armband aus Papier oder Karton wird mit Symbolen versehen, die positives oder negatives Verhalten darstellen (z. B. Smiley für Höflichkeit, Blitz für Konflikt). Die Person trägt es und notiert selbstständig, wann sie Punkte hinzufügt oder abzieht – basierend auf ihrem eigenen Empfinden oder Feedback von anderen. Die Umgebung wird nicht verändert, aber die Person reflektiert ihr Verhalten durch das physische Dokumentieren. Der Fokus liegt auf der Selbstbeobachtung und dem Bewusstsein für sozialen Einfluss.

Invertiert – Stadtbild als gemeinschaftliches Kunstprojekt

Anstatt eine KI die Umgebung anpassen zu lassen, gestalten die Menschen selbst ihre Umgebung basierend auf ihrem kollektiven Verhalten. Eine Wand oder ein großes Blatt Papier wird zur „Score-Wand“. Jede Person malt oder klebt Elemente darauf, die ihre Stimmung oder ihr Verhalten symbolisieren (Blumen für Freundlichkeit, Risse für Konflikte). Die Wand verändert sich durch direkte menschliche Interaktion, nicht durch Algorithmen. Die Frage wird umgedreht: Nicht Technologie bestimmt das Bild, sondern die Menschen selbst.

Transformiert – Wahrnehmungsbrille mit zufälliger Verzerrung

Eine einfache Brille (z. B. aus Pappe oder einer alten Sonnenbrille) wird mit farbigen Folien oder zerkratzten Linsen versehen. Die Person sieht ihre Umgebung verzerrt, aber nicht aufgrund eines Scores, sondern durch reinen Zufall. Die Brille provoziert die Frage: Was wäre, wenn die Wahrnehmung gar keine Logik hätte? Wenn Schönheit oder Hässlichkeit willkürlich wären? Die Person erlebt eine Welt, in der Kontrolle illusorisch ist – und hinterfragt damit das Konzept der „gerechten“ Bewertung.

ethics

Reflektiert die ethische Perspektive auf das Projekt - sucht und hinterfragt kritische blinde Flecken im Konzept und entwickelt erbauliche loesungsorientierte Fragestellungen.

Gesellschaftliche Kontrolle durch Punktesystem

Das „DreamScore“-System fördert Überwachung und sozialen Druck. Es belohnt Konformität und bestraft Abweichung, was individuelle Freiheit einschränkt. Eine Lösung wäre, das System freiwillig zu gestalten und anonyme Feedback-Mechanismen einzubauen, um Manipulation zu verhindern.

Diskriminierung durch Algorithmen

Die KI-basierte Bewertung kann Vorurteile verstärken, z. B. bei Menschen mit neurodivergentem Verhalten oder kulturell unterschiedlichen Ausdrucksweisen. Transparente Kriterien und menschliche Überprüfung könnten Fairness erhöhen.

Kolonialismus in digitaler Form

Das System erzwingt eine bestimmte Vorstellung von „gutem“ Verhalten, die westliche oder elitäre Normen widerspiegeln könnte. Eine dezentrale, kulturell anpassbare Regelgestaltung würde Diversität fördern.

Ökologische Blindstellen

Die Technologie benötigt Energie und Ressourcen, während sie soziale statt ökologische Probleme priorisiert. Ein integrierter Nachhaltigkeits-Score könnte umweltfreundliches Verhalten belohnen.

Barrierefreiheit und Zwang

Die implantierte Kontaktlinse schließt Menschen mit Sehbehinderung oder Technikablehnung aus. Alternative Zugänge (z. B. Audiodeskription) und Opt-out-Möglichkeiten wären fairer.

Macht in KI-Händen

Eine undurchsichtige KI entscheidet über Lebensqualität – wer kontrolliert sie? Demokratische Gremien und Open-Source-Algorithmen könnten Machtmissbrauch verhindern.

intrinsics

Reflektiert zugrundeliegende intrinsische Motivation des Projektes - untersucht diese kritisch und reflektiert mit erbaulichen Fragestellungen.

Die Schönheit als kollektive Droge

Die Stadt als Wunschmaschine – je mehr du dich anpasst, desto schöner wird sie. Aber wer bestimmt, was schön ist? Die KI, die Politik, oder die Summe aller Ängste und Sehnsüchte? Wenn Harmonie zur Pflicht wird, was passiert mit denen, die nicht harmonisch sein können?

Das Armband als moralische Fessel

Dein Puls, dein Lächeln, dein Schweigen – alles wird gewertet. Du bist nicht mehr du, sondern ein Datenpunkt im kollektiven Glück. Aber kann man Vertrauen erzwingen? Oder wird Freundlichkeit zur Performance, sobald sie überwacht wird?

Die Stadt als persönliche Halluzination

Deine Kindheit, deine Ängste, deine Vorlieben – alles formt, was du siehst. Eine Utopie für dich, ein Albtraum für deinen Nachbarn. Wenn Realität individuell ist, gibt es dann noch eine gemeinsame Wahrheit? Oder leben wir alle nur in unseren eigenen Algorithmen?

Der Score als sozialer Tod

90 Punkte – du bist ein Gewinner. 49 Punkte – du bist ein Problem. Aber wer fällt wirklich durch? Die Unangepassten, die Kranken, die Einsamen? Oder nur die, die sich nicht gut genug verstellen können?

Die KI als letzte Instanz

Die Politik ist nur noch Theater, die Regeln schreibt die Maschine. Aber wer programmiert die Maschine? Wer entscheidet, was "förderlich" ist? Wenn die KI perfekt wäre – warum brauchen wir dann noch Menschen?

Der Traum, der zur Falle wird

Am Anfang war es eine Lösung. Jetzt ist es ein Käfig. Du kannst nicht mehr aussteigen, ohne alles zu verlieren. Aber was gewinnst du, wenn du nur noch spielst, um Punkte zu sammeln?

Die Gamification der Moral

Helfen gibt Pluspunkte, Streit kostet dich. Soziales Verhalten als Highscore-Jagd. Aber wenn Gutsein ein Spiel wird – wer betrügt dann zuerst?

Die Stadt als lebendiger Organismus

Sie atmet, sie blüht, sie fault – abhängig von eurem Verhalten. Doch wer heilt sie, wenn sie krank wird? Die KI? Die Menschen? Oder bricht sie einfach zusammen, wenn zu viele aufhören, zu glauben?

Die neue Klassengesellschaft

Die Hochscorer in rosa Paradiesen, die Verlierer in düsteren Zonen. Aber was passiert, wenn die Unterschicht zu groß wird? Wird die KI sie löschen – oder revoltiert sie?

Die Illusion der Kontrolle

Du denkst, du kannst dein Schicksal steuern. Aber in Wahrheit reagierst du nur auf Regeln, die sich ständig ändern. Was bleibt von dir übrig, wenn du nur noch ein Reaktionsmuster bist?

network

Zeigt Verbindungen oder interessante Überschneidungen zu anderen Konzepten innerhalb dieser BREEDER Instanz.

1 Ähnlichstes Konzept: Dreamguard

Dreamguard ist ein Neuro-Wearable, das Träume analysiert und beeinflusst, ähnlich wie der „DreamScore“ individuelle Wahrnehmungen steuert. Beide Konzepte nutzen Technologie, um innere Zustände nach außen zu spiegeln und kollektive oder individuelle Verhaltensmuster zu modellieren. Während der DreamScore soziale Kontrolle ausübt, zielt Dreamguard auf persönliche Schlafoptimierung – doch beide basieren auf Überwachung und Anpassung.

Link

2 Interessante Kombination: Symbiotische Nachbarschaften

Die „Symbiotischen Nachbarschaften“ verbinden nachhaltiges Wohnen mit Gemeinschaft – ein Gegenentwurf zur anonymen Kontrolle des DreamScore. Die Kombination beider Konzepte könnte zeigen, wie kollektives Verhalten ohne Überwachung funktioniert: Statt KI-gesteuerter Anpassung würde gemeinschaftliche Permakultur die Stadt gestalten.

Link

3 Konträres Konzept: Der Demokratieteppich

Der Demokratieteppich fordert respektvolle Teilhabe durch Vielfalt – das Gegenteil des homogenisierenden DreamScore-Systems. Während der Score Konformität belohnt, zeigt der Teppich, dass echte Harmonie nur durch Unterschiede entsteht. Eine Verbindung beider Ideen könnte explorieren: Wie sähe eine Stadt aus, die Diversität statt Anpassung belohnt?

Link

Loaded php.ini: /var/www/vhosts/system/designfiction.turboflip.de/etc/php.ini

upload_max_filesize: 45M

post_max_size: 48M

.png)